Impulsar

IA responsable a escala

A medida que las herramientas de IA transforman la toma de decisiones, las organizaciones deben actuar con previsión. La IA responsable no es solo una medida de cumplimiento; es un imperativo empresarial.

Los mayores obstáculos

Escalar la IA responsable es un desafío real para grandes empresas y fuerzas laborales amplias debido a la falta de claridad en la propiedad, marcos aislados y vacíos éticos

Falta de una propiedad clara de la IA a escala

Los equipos carecen de una alfabetización unificada en IA

Los principios de IA responsable no se escalan

Preocupaciones éticas y de sesgo en fuerzas laborales numerosas

Marcos de gobernanza fragmentados

Brechas de confianza con partes interesadas y personas usuarias

Cómo Serein ayudó al estudiantado de Ingeniería Biomédica de King’s College a abordar los sesgos inconscientes

Intervenciones clave

- Sesiones interactivas de concientización sobre sesgos

- Aprendizaje gamificado sobre diseño inclusivo

- Herramientas basadas en investigación para la reducción de sesgos

Impacto de Serein

- Comprensión más profunda de la ciencia del sesgo inconsciente

- Habilidades prácticas para crear tecnología equitativa

- Mentalidad investigativa con mayor conciencia de género

- Futuras ingenieras preparadas para la inclusión

Cómo ayudamos

Permitimos a las empresas escalar la IA responsable mediante diagnósticos, guías específicas por flujo de trabajo y formación basada en escenarios con alcance global.

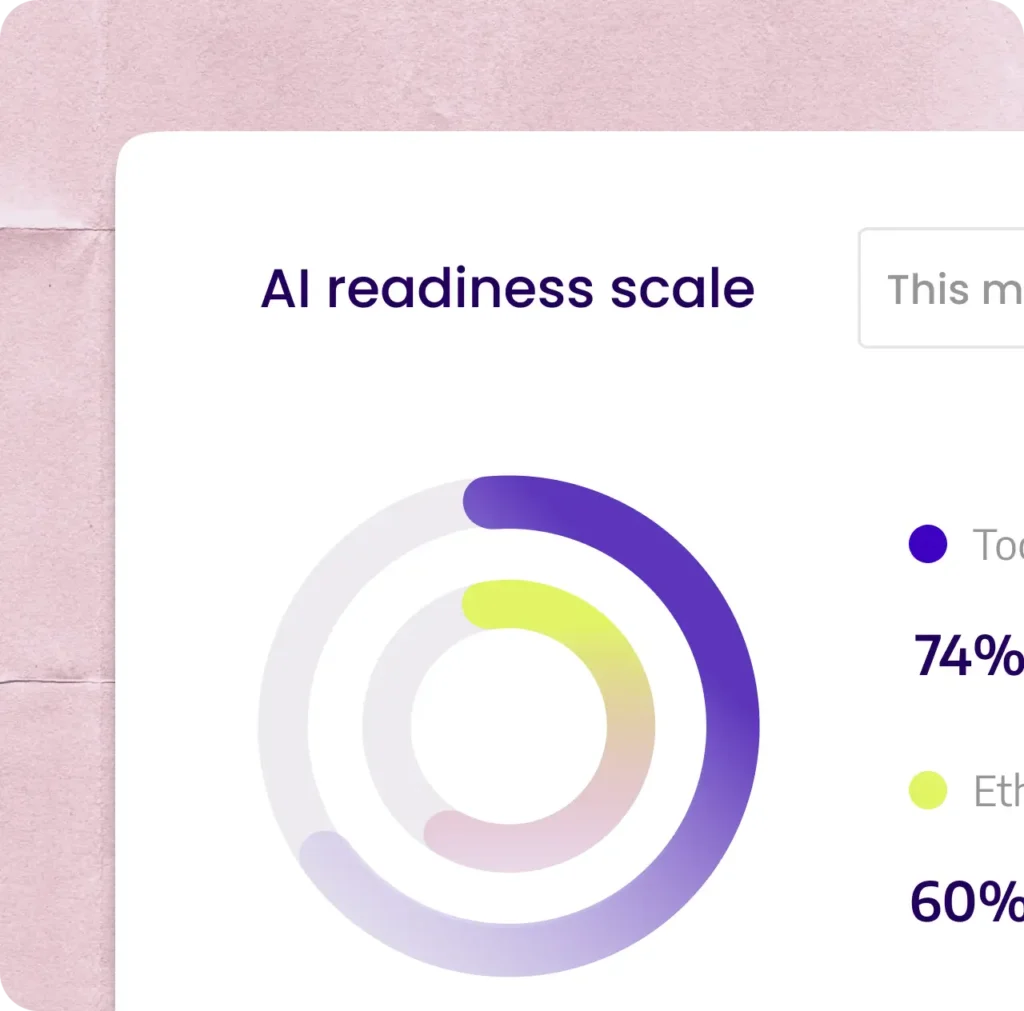

Análisis de preparación en IA

Una herramienta diagnóstica escalable que revela cómo las personas colaboradoras en todos los niveles interactúan con la IA, identificando dónde la confusión o la cautela pueden estar frenando a los equipos.

Guías de IA por puesto

Los equipos co-crean lineamientos de uso vinculados a sus flujos de trabajo reales, aclarando dónde la IA aporta valor, dónde no, y cómo evitar riesgos antes de que ocurran.

Círculo de personas embajadoras de IA

Iniciativa facilitada y liderada por pares que capacita a quienes adoptan la IA de forma temprana para compartir aprendizajes, señalar riesgos y convertir la IA responsable en una prioridad compartida a escala.

Manuales de IA responsable

Recursos de e-learning basados en escenarios que traducen la ética de la IA en decisiones cotidianas, ayudando a fuerzas laborales amplias a gestionar la transparencia y la rendición de cuentas.

Lo que dicen nuestras clientas

Conozca cómo nuestrss socias/os utilizan nuestras soluciones para generar confianza, fortalecer la cultura y convertir el aprendizaje cotidiano en un impacto duradero en el lugar de trabajo

What stands out most about Serein is how it makes the science behind its work accessible, while at the same time demonstrating why a rigorous approach is absolutely essential for impact.

Kelly

Sagana

Collaborating with Serein for the Emotional Inclusion workshop was a wonderful experience! We’re grateful to Arathi Kannan and the Serein team for their openness, support, and thoughtful care in curating a session tailored to GBL’s needs. The safe, compassionate space encouraged honest reflection, while the case study, research insights, and card game made learning engaging and meaningful. We look forward to more collaborations!

People Operations Team

Good Business Lab (GBL)

We had a great experience with Serein’s PoSH training. The workshop was comprehensive and expertly led, with trainers explaining complex concepts clearly and engagingly. It covered legalities, gender-neutral policies, and current workplace topics, making it relevant and impactful. The team’s preparation and depth of knowledge were impressive. We appreciate Serein’s effort and look forward to future collaborations.

Sherlin Noronha

Gameberry

Serein has now worked with more than a dozen of our companies. They are highly recommended for anyone who needs support with any/all gender and diversity-related issues.

Avantika Vohra

Principal Blume Venture Partners

We partnered with Serein to build a sustainable, equitable institution. Dr. Ishani Roy and her team have been invaluable in addressing complex queries and guiding our leadership on responsibilities as VC board members. Serein has led engaging PoSH and harassment awareness sessions for our team and portfolio companies. We highly recommend them to VCs navigating India’s evolving startup and regulatory landscape.

Ria Shroff Desai

Blume

Moonfrog has partnered with Serein for eight years, and the journey has been truly fulfilling. It’s inspiring to see Serein grow and lead in building respectful, inclusive, and psychologically safe workplaces. Their programs are engaging, experiential, and impactful. We’re excited to continue this partnership and will always be proud cheerleaders of Serein’s meaningful work.

Shantini D

Valliappa Foundation

Moonfrog has partnered with Serein for eight years, and the journey has been truly fulfilling. It’s inspiring to see Serein grow and lead in building respectful, inclusive, and psychologically safe workplaces. Their programs are engaging, experiential, and impactful. We’re excited to continue this partnership and will always be proud cheerleaders of Serein’s meaningful work.

Varsha Sharma

Lead: People & Culture at Moonfrog Labs

An engaging workshop that wove the key messages through experiential exercises and stories. I recommend Serein to any organisation that wants to instill respect for everyone and not just toeing the law.

Kevin Freitas

CHRO Of Dream11

Serein Inc. has been one of the most professional, amiable, solution-focused organizations I have ever worked with. Serein Inc. is my go-to team for all things related to diversity, inclusion, PoSH, and workplace health and safety.

Sowmya Devaiah Anish

Head - People Practices at Probe Information Services

Moonfrog has partnered with Serein for eight years, and the journey has been truly fulfilling. It’s inspiring to see Serein grow and lead in building respectful, inclusive, and psychologically safe workplaces. Their programs are engaging, experiential, and impactful. We’re excited to continue this partnership and will always be proud cheerleaders of Serein’s meaningful work.

Varsha Sharma,

Lead: People & Culture at Moonfrog Labs

El retorno de inversión de la adaptación

Los equipos ganan confianza y claridad para usar la IA de forma responsable a escala, acelerando la entrega de productos, reduciendo riesgos y fortaleciendo la confianza de las partes interesadas.

Impulsar

Lanzamientos de producto más rápidos y seguros

Con controles integrados y responsabilidad compartida, los equipos están preparados para ofrecer soluciones de IA a clientes, sin omitir la evaluación de riesgos a escala.

Impulsar

Mayor confianza de las partes interesadas

La gobernanza de la IA, escalada en fuerzas laborales amplias, demuestra a entes reguladores, socios y personas usuarias que su práctica de IA es responsable e innovadora.

Impulsar

Adopción interna con confianza

Cuando los equipos comprenden los riesgos y las responsabilidades de la IA, están mejor preparados y más dispuestos a utilizarla de manera reflexiva a escala.

Centro de conocimiento

Explore nuestra colección seleccionada de informes, blogs y videos para obtener perspectivas que mejoren el desempeño laboral y generen un impacto duradero

Riesgos de contratación con IA

La IA acelera la contratación pero puede amplificar sesgos; la supervisión humana y la transparencia garantizan una selección justa

Proteger los datos de la empresa

La protección efectiva de datos requiere contraseñas fuertes, descargas cautelosas y uso claro de redes sociales

Construyendo justicia de género

La reforma legal es clave para crear una sociedad más segura y equitativa para todas las personas empleadas

El cumplimiento importa

Un cumplimiento efectivo depende de comités formados, supervisión y de que las personas empleadas sepan a dónde acudir

Ética de la IA

Incorpore prácticas éticas de IA para fomentar confianza, responsabilidad e innovación responsable en el trabajo

IA en el trabajo

La adopción efectiva de IA depende de la capacitación, la confianza y el apoyo para empoderar al personal hacia el éxito

FAQs

Los desafíos incluyen una propiedad poco clara, gobernanza fragmentada, baja alfabetización compartida en IA, principios inconsistentes y brechas de confianza en fuerzas laborales grandes y globales.

A través de una herramienta diagnóstica escalable que mapea la madurez en IA por roles y niveles, identificando confusión, brechas de uso y riesgos de adopción.

Serein ofrece formación a través de e-learning interactivo, talleres en vivo, círculos liderados por pares y laboratorios de liderazgo, adaptados al tamaño de la organización y a la complejidad de los flujos de trabajo.

La formación está disponible en múltiples idiomas globales, con localización según el contexto cultural y regulatorio, lo que garantiza que los equipos en distintas regiones comprendan y apliquen claramente los principios de IA responsable.

Sí. Realizamos talleres en todo el mundo, con casos específicos por región, facilitación multilingüe y debates culturalmente relevantes.

Un uso de la IA más seguro y alineado, mayor confianza de las partes interesadas, lanzamientos de productos más rápidos y seguros, y una cultura compartida de rendición de cuentas.